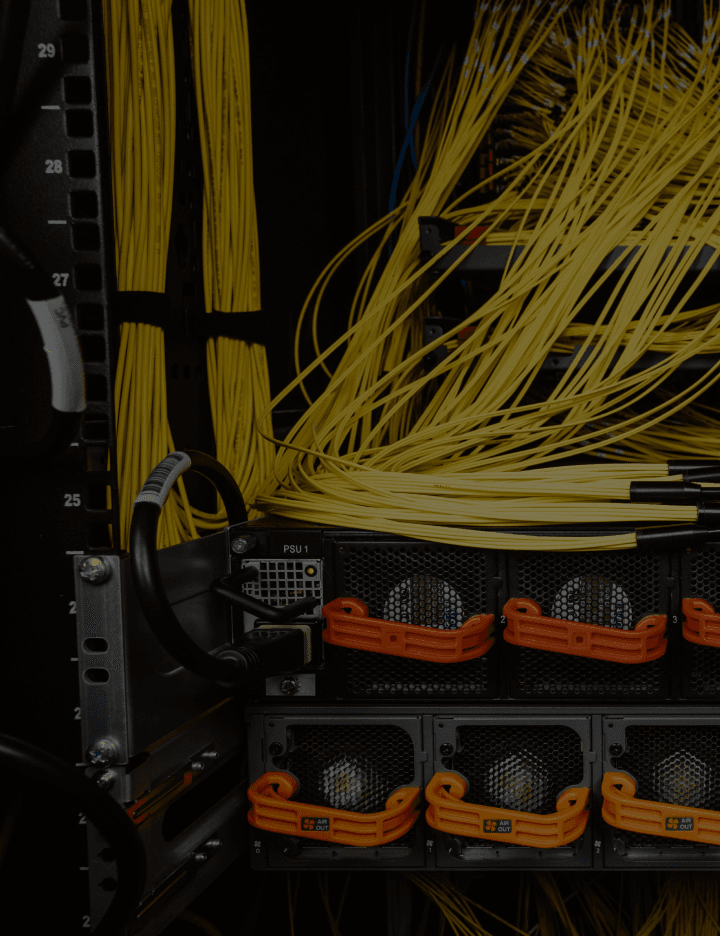

Подключать, чинить и поддерживать серверы всего Яндекса: как устроена работа инженеров дата-центров

Содержание

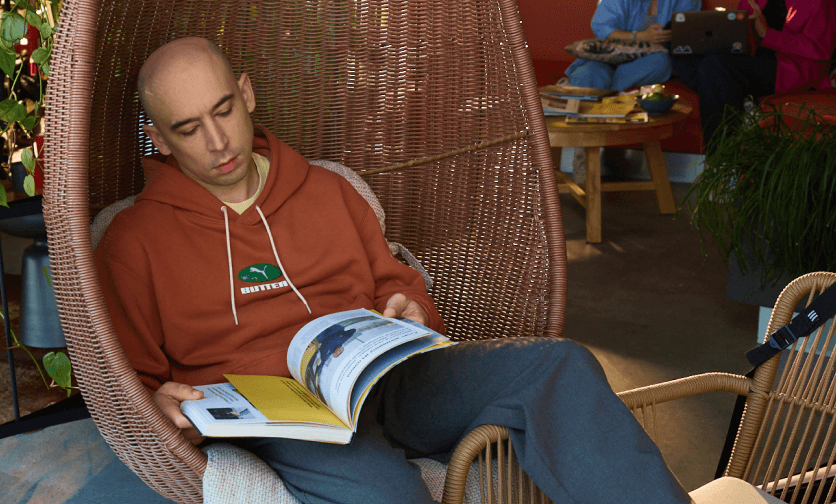

Володя Аксёнов работает в Яндексе уже 10 лет. Он рассказывает, чем занимаются инженеры в дата-центрах, как учат новичков и пишут регламенты. А ещё вспоминает, как он устранил свою первую аварию и полюбил работу.

Я учился на инженера автоматизированных систем управления

В 2001 году у нас в Сасовском лётном училище как раз появилось такое направление. Подумал: «Связано с компьютерами, перспективно, почему нет?» Практику проходил на местном телеканале, который базировался у нас в училище. Помогал переходить с аналоговых носителей в цифровой мир: тогда они ещё монтировали видео с помощью титровальных машин. После совмещал работу монтажёром на местном телеканале и техником ТСО в училище.

Через несколько лет в училище стал сетевым администратором и подключал по вайфаю удалённые площадки. Дотягивался до них своими сетевыми руками, чтобы не идти полтора километра на окраину лётного поля. Мне это нравилось: подключаю, и огонёк загорается, в сети появляется жизнь. Бальзам на душу.

А в 2012 году в Сасово начали строить дата-центр Яндекса. Мои знакомые работали там и периодически зазывали к себе. Но я не особо рвался: в училище у меня было шесть серверов, всё знакомо и автоматизировано. Так меня не могли заманить четыре года. А потом в училище сократили финансирование, и я решил сходить на интервью в Яндекс.

С собеседования вышел немного подавленным. На прошлой работе я развивал серверную инфраструктуру, поднимал сетевые службы, а здесь нужно было чинить серверы. Но всё равно решил попробовать и в сентябре 2016-го пришёл в Яндекс.

Через несколько месяцев я начал болеть работой

Когда испытательный срок только-только закончился, в дата-центре случилась авария. Сломалась важная железка, и московскому сетевому инженеру нужна была помощь с починкой. Никто из коллег не смог выехать: один сильно болел, у другого в деревне навалило снега по крышу, а третий и вовсе был в Москве. Получилось, остался только я.

В два часа ночи мне позвонил руководитель, через 20 минут я был на месте — и до семи утра мы с сетевым инженером чинили коммутатор ядра. Перебрали все возможные варианты, но так и не починили, пришлось решать вопрос с вендором.

Но в процессе у меня возникло чувство, что я делаю что-то очень важное, спасаю весь большой Яндекс. И после этого всё постепенно стало становиться моим, родным, знакомым.

Потом я получил первую масштабную самостоятельную задачу. В то время сети были не очень скоростные, поэтому у нас стояли два коммутатора агрегации/дистрибуции, которые обслуживали весь дата-центр. Но они не соприкасались: часть стоек подключалась к одному, остальные — к другому. Мне нужно было поставить новый большой коммутатор и сделать сеть, которая проходила бы в каждый свитч, каждую стойку в дата-центре.

Задача была громоздкая: нужно разработать схему, протянуть провода из коммутационной в кластер и всё задокументировать. Но поручение запомнилось и понравилось, потому что у меня появилось первое творчество. Я мог сам решить, как это размножить на простые операции, в какой момент подключить коллег.

Дальше все мои задачи были связаны с изменением конфигураций: запускал всевозможные модули, ставил серверы, делал апгрейды. Часто оставался за руководителя в его отсутствие. Потом мы начали развивать инцидент-менеджмент. У меня не было достаточных знаний в этой области, потому что моя сильная сторона — это не поломки, а планирование работы над большими задачами. В итоге мы сначала подготовили человека под эту должность, а потом перестроили структуру отдела.

Я предложил поделить команду на две группы

Теперь у нас есть инцидент-менеджеры и менеджеры по проектному планированию. Потому что переключаться между задачами сложно: вот человек чинит текучку, а вот его просят срочно поставить три сервера.

Этот опыт переняли и в остальных дата-центрах Яндекса, поэтому у нас практически нет универсалов: смотрим на навыки и бэкграунд кандидата и распределяем его в одну из команд.

Поломками занимаются IT-специалисты и дежурные инженеры

У нас есть роботизированная система, она различает около 360 разновидностей поломок. Что-то чинит автоматически, а с чем-то разбираются уже IT-специалисты: анализируют логи, меняют неисправные компоненты.

На дежурных инженерах лежат простые действия — например, заменить сломавшийся диск или планку оперативной памяти. В день таких задач может быть около сотни.

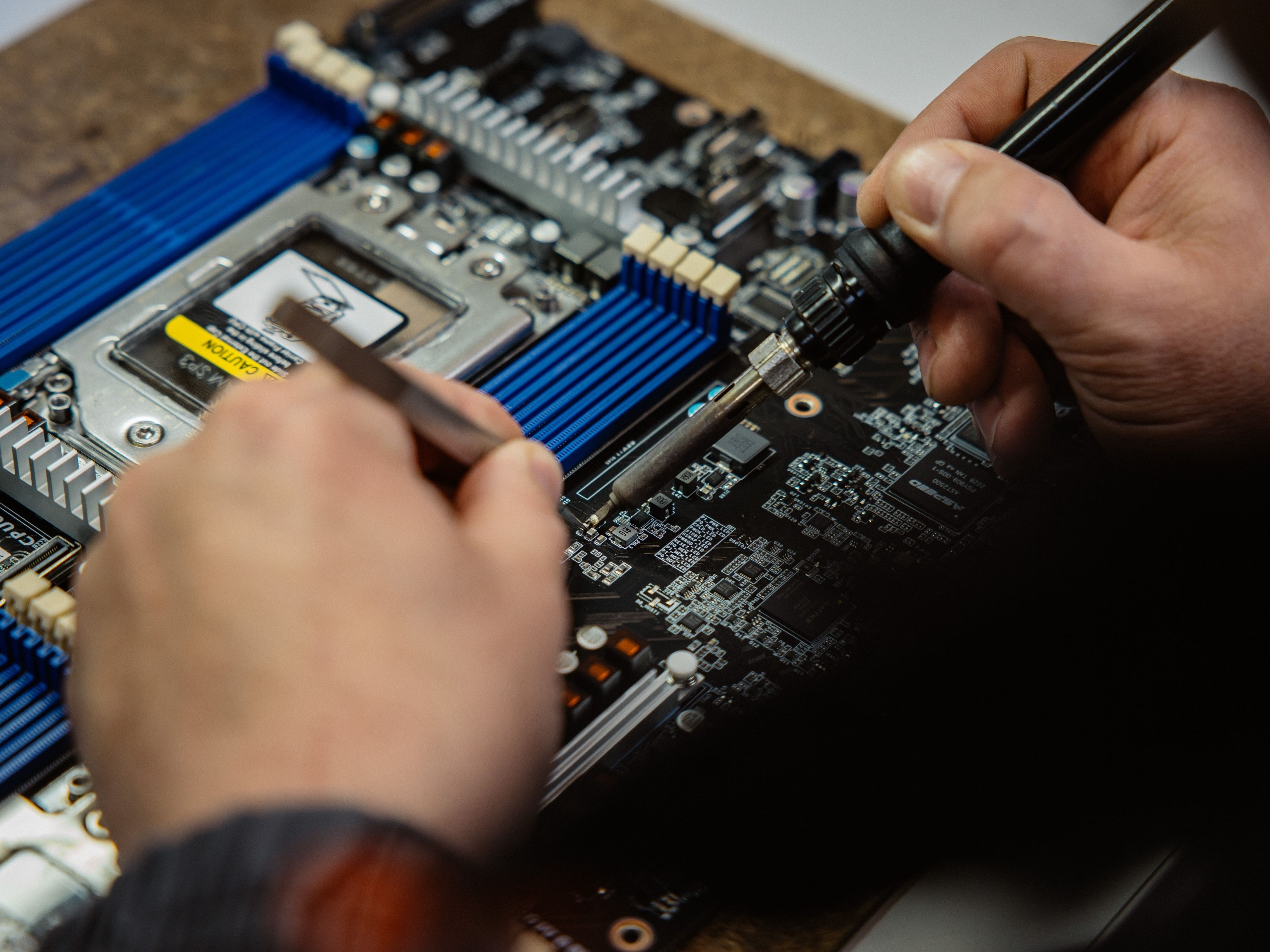

Отдельно есть ребята, которые занимаются пайкой поверхностных компонентов. Они могут паять детали меньше миллиметра в длину. Это «пыль», которую видно только на белой поверхности. Я называю их некромантами, потому что они воскрешают умершие серверы

Для нештатных ситуаций есть Emergency team

Это координаторы, которые думают, как решить проблему: разбираются в масштабах и причинах аварии и решают, нужно ли на месте присутствие IT-специалиста. Если авария связана с инженерными системами — её ликвидируют дежурные инженеры. Если с серверным или сетевым оборудованием, которое нельзя починить простым ребутом, — дежурные специалисты IT.

Кроме устранения аварий, команда проводит учения. У нас есть якорные дата-центры — они равнозначны по объёмам. То есть мы распределяем серверы сервисов так, чтобы при непредвиденном отключении одного из дата-центров не пострадали пользователи сервисов Яндекса. Мы называем такую философию «минус один дата-центр» и периодически проверяем: сами закрываем от внешнего мира один или другой.

Бо́льшая часть серверного оборудования в дата-центрах разработана Яндексом

С 2013 года мы наладили производство с опорой на стандарты Open Compute Project (OCP) и стали устанавливать свои стоечные решения. Такого оборудования нет нигде. Поэтому нереально нанять человека, который сразу умеет чинить наш OpenRack.

Так что в плане адаптации расписан каждый день: какие интерфейсы человек должен освоить, какие доступы получить, как настроить окружение. Прописано даже, какие нужно сделать закладки в браузере. Потом пару недель новичок ходит везде вместе с коллегой: задаёт вопросы, учится. После начинаем давать самостоятельные задачи — конечно, такие, где нельзя крупно накосячить.

Во время адаптации есть две «стрессовые» недели: одна в середине, вторая ближе к концу. В это время сотруднику дают очень много задач, чтобы понять, как он может в случае аврала оптимизировать свой рабочий день. Потом мы сравниваем две эти недели: сколько задач закрыл в первый раз, какой прогресс был во второй. Конечно, в это время новичка страхуют его ментор и инцидент-менеджер.

Дважды в год мы проводим аттестацию

Проверяем, насколько хорошо сотрудники знают регламенты. Потому что их писали по следам ошибок. Например, я в своё время не знал, что такое фазные группы на колодках распределения питания, а когда узнал, было уже поздно: отключился весь дата-центр. Причём по старой документации всё было правильно, нагрузку по фазам я распределил. Но не учёл, что в каждой фазе есть две фазные группы и нужно распределить ещё и по ним. А потом, как виновник торжества, разрабатывал регламент подключения оборудования на критической инфраструктуре.

Но новые сотрудники не застали прошлые прецеденты, поэтому для них обязательна аттестация. Если два раза подряд у человека результат выше 95%, то в следующий раз мы его освобождаем. Но с условием: если средний балл команды, где он работает, упадёт ниже 83% — все идут на повторное обучение.

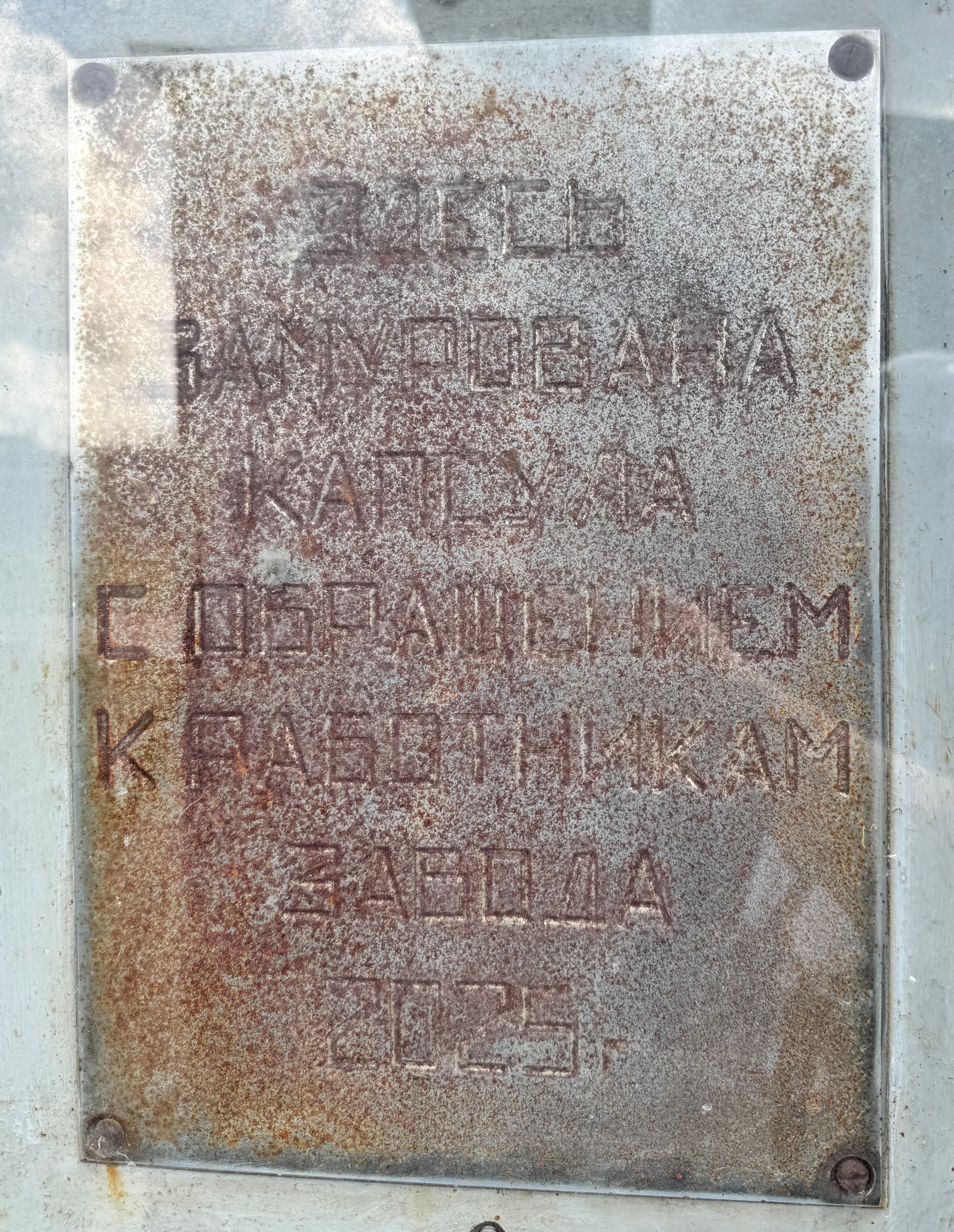

В каждом дата-центре свои байки и легенды. В Сасово, например, была капсула времени

Наш дата-центр расположен на территории бывшего станкостроительного завода. В первый же день работы я узнал, что в 1975 году тут замуровали капсулу времени с предписанием открыть её через 50 лет, в 2025 году.

Когда мы вышли на работу в январе 2025-го, я первым делом написал руководителю дата-центра: «Сергей, давай капсулу вскрывать». Решили это сделать осенью, на день открытия дата-центра. Хотели устроить всё торжественно, даже пригласить директора завода, у которого приобрели территорию.

Но незадолго до назначенной даты помещение перестраивали, меняли отопление цехов, чтобы сделать кластеры фрикулинговыми. Позвали рабочих, чтобы они заменили металлическую обшивку на тёплый материал. А они не знали про капсулу и разобрали эту часть стены. Мы поинтересовались, где капсула, и оказалось, что за рамкой ничего не было — просто ниша кирпичной кладки.

Ещё одна история из дата-центра Сасово — про сосиски

Когда приехали первые образцы дисковых полок для новой серверной платформы, они оказались неидеальными. Чтобы вынуть одну полку из стойки, надо было задействовать двух человек: первый снимает фиксацию и тянет на себя, а второй подталкивает сзади. При этом нужно было действовать максимально аккуратно: если неудачно взяться, можно прищемить пальцы.

Мы решили снять видео, чтобы наглядно зафидбэчить проблему в R&D-отдел. Но сами травмироваться не хотели, поэтому съездили в магазин и купили сосиски на замену пальцев. Записали видео, отправили. Команда R&D посмеялась над нашим креативом и поставила задаче высокий приоритет: дизайн быстро доработали и передали на завод. В результате следующая партия, как и все после, приехала с удобными ручками, которые позволяют безопасно и легко извлекать полку из стойки одному специалисту.